PersonNeRF: Personalized Reconstruction from Photo Collections ( CVPR 2023 Accepted 論文 )

PersonNeRF:

Personalized Reconstruction

from Photo Collections

( CVPR 2023 )

Brian Curless 1,2

Ira

Kemelmacher-Shlizerman 1,2

1University

of Washington

2Google

Research

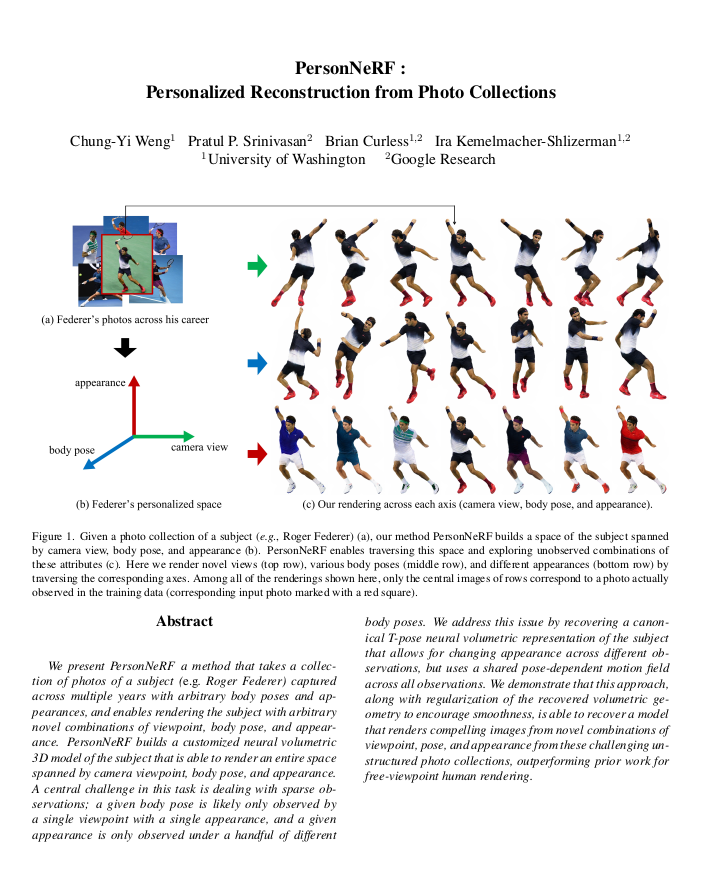

PersonNeRF builds a

personalized space from photos of Roger Federer, rendering with novel combinations

of viewpoint, body pose, and appearance.

Try a laptop browser

if the video can't load

Abstract

We present PersonNeRF, a method

that takes a collection of photos of a subject (e.g., Roger Federer) captured

across multiple years with arbitrary body poses and appearances, and enables

rendering the subject with arbitrary novel combinations of viewpoint, body

pose, and appearance. PersonNeRF builds a customized neural volumetric 3D model

of the subject that is able to render an entire space spanned by camera

viewpoint, body pose, and appearance. A central challenge in this task is

dealing with sparse observations; a given body pose is likely only observed by

a single viewpoint with a single appearance, and a given appearance is only

observed under a handful of different body poses. We address this issue by

recovering a canonical T-pose neural volumetric representation of the subject

that allows for changing appearance across different observations, but uses a

shared pose-dependent motion field across all observations. We demonstrate that

this approach, along with regularization of the recovered volumetric geometry

to encourage smoothness, is able to recover a model that renders compelling

images from novel combinations of viewpoint, pose, and appearance from these

challenging unstructured photo collections, outperforming prior work for

free-viewpoint human rendering.

Gallery

Roger Federer

Novak Djokovic

Rafael Nadal

Serena Williams

Exploring Federer's Space

Resources

BibTex

@article{weng2023personnerf,

title={Person{N}e{RF}: Personalized Reconstruction from Photo Collections},

author={Weng, Chung-Yi and

Srinivasan, Pratul P. and

Curless, Brian and

Kemelmacher-Shlizerman, Ira},

journal={CVPR},

year={2023}

}

Acknowledgement

We thank David Salesin and Jon Barron for their valuable feedback. This project is a tribute from the first author, a die-hard tennis fan, to Novak, Rafa, Roger, and Serena. He feels blessed to have lived in their era and wishes it would never come to an end.

This work was funded by the UW Reality Lab, Meta, Google, Oppo, and Amazon.

____________________________________________________________________________________________

arXiv:2302.08504

(cs)

[Submitted on 16

Feb 2023]

PersonNeRF:

Personalized Reconstruction from Photo Collections

Chung-Yi Weng,

Pratul P. Srinivasan, Brian Curless, Ira Kemelmacher-Shlizerman

We present

PersonNeRF, a method that takes a collection of photos of a subject (e.g. Roger

Federer) captured across multiple years with arbitrary body poses and

appearances, and enables rendering the subject with arbitrary novel

combinations of viewpoint, body pose, and appearance. PersonNeRF builds a

customized neural volumetric 3D model of the subject that is able to render an

entire space spanned by camera viewpoint, body pose, and appearance. A central

challenge in this task is dealing with sparse observations; a given body pose

is likely only observed by a single viewpoint with a single appearance, and a

given appearance is only observed under a handful of different body poses. We

address this issue by recovering a canonical T-pose neural volumetric

representation of the subject that allows for changing appearance across

different observations, but uses a shared pose-dependent motion field across

all observations. We demonstrate that this approach, along with regularization

of the recovered volumetric geometry to encourage smoothness, is able to

recover a model that renders compelling images from novel combinations of

viewpoint, pose, and appearance from these challenging unstructured photo

collections, outperforming prior work for free-viewpoint human rendering.

PersonNeRF:照片集的個性化重建

arXiv.cs.CV

Pub Date : 2023-02-16

DOI :

arxiv-2302.08504

Chung-Yi Weng,

Pratul P. Srinivasan, Brian Curless, Ira Kemelmacher-Shlizerman

我們介紹了 PersonNeRF,這是一種收集物件(例如羅傑·費德勒)多年拍攝的具有任意身體姿勢和外觀的照片集的方法,並且能夠使用觀點、身體姿勢和外觀的任意新穎組合來渲染物件。PersonNeRF 構建了一個定制的主體神經體積 3D 模型,能夠渲染由相機視角、身體姿勢和外觀跨越的整個空間。這項任務的一個核心挑戰是處理稀疏觀察;給定的身體姿勢可能只能通過具有單一外觀的單個視點觀察到,並且給定的外觀只能在少數不同的身體姿勢下觀察到。我們通過恢復主體的典型 T 形神經體積表示來解決這個問題,該表示允許在不同的觀察中改變外觀,但在所有觀察中使用共用的姿勢相關運動場。我們證明了這種方法,連同恢復的體積幾何的正則化以鼓勵平滑,能夠恢復一個模型,該模型從這些具有挑戰性的非結構化照片集的觀點、姿勢和外觀的新穎組合中呈現引人注目的圖像,免費優於先前的工作- 觀點人類渲染。

____________________________________________________________________________________________

NeRF 擺脫了“動畫照片”的束縛

( NeRF Breaks Free From Being an ‘Animated Photo’)

英國AI/VR初創公司Metaphysic

https://metaphysic.ai/nerf-breaks-free-from-being-an-animated-photo/

NeRF Breaks

Free From Being an

NeRF 擺脫了“動畫照

片”的束縛

馬丁·安德森( Martin Anderson) 報導 :

我是 Martin Anderson,一位專注於機器學習、人工智能、大數據和密切相關主題的作家,重點是圖像合成、計算機視覺和 NLP。

隨著當前圍繞穩定擴散的所有喧囂,神經輻射場 (NeRF) 最近並沒有得到太多的愛。雖然它算不上是一種“遺留”技術(它在 2020 年才出現),但與潛在擴散網絡甚至生成對抗網絡的豐富且可探索的潛在空間相比,它可以說是一種神經渲染的笨拙方法。甘)。

NeRF 難以編輯,難以包含在 deepfakes 管道中,並且比人類合成更適合城市場景和靜態表示,儘管如此,NeRF 可能仍然是目前可用於人類形式的最準確的神經表示技術——但它並不是最有想像力的。

與 Stable Diffusion 不同,您無法“搜索”NeRF 的潛在空間以尋找隱藏的寶藏,因為 NeRF 表示幾乎僅限於它從中導出其網絡的照片中存在的任何材料。如果該材料是工作室中的女性,您將無法干預從這些源圖像生成的訓練模型(至少不能以任何簡單或有意義的方式進行干預)。用侏羅紀公園 (1993) 中的約翰·哈蒙德 (John Hammond) 的話說,NeRF 是“一種騎行”。

個人神經網絡

然而,華盛頓大學和谷歌研究院之間的一項新合作為 NeRF 可以發展成為一個更豐富、更分離的空間帶來了希望。 PersonNeRF 提供了一種神經輻射場表示,它不像傳統的 NeRF 管道那樣針對同一事物的多個視點(通常在同一時刻拍攝)進行訓練; 而是同一個人的多張抽象照片,從不同的角度看,穿著各種不同類型的衣服。

PersonNeRF 允許用戶探索來自多個雜色照片源的所有廣義方面的“立方體”。 來源:https://grail.cs.washington.edu/projects/personnerf/

在 PersonNeRF 的測試用例中,研究人員收集了瑞士前職業網球運動員羅傑·費德勒多年的小型數據集,並將其訓練成一個能夠根據輸入圖像概括費德勒圖像的網絡。

PersonNeRF 在有限的源數據上泛化得足夠好,用戶可以指定相機視圖、身體姿勢和外觀(包括衣服,只要衣服在訓練數據集中作為示例)。 資料來源:https://arxiv.org/pdf/2302.08504.pdf

與 Stable Diffusion 等系統不同,後者擁有數百萬個抽象和相似的圖像,可以從中根據主題編造新的姿勢和配置,PersonNeRF 僅限於包含在數據集中的表示——但它提供的概念證明表明 Neural Radiance Fields 適用於廣義和可探索的空間,具有訓練更高、更多樣化的圖像集的潛力,以增加不同輸出的可能性。

這篇新論文的標題是 PersonNeRF:來自照片集的個性化重建,來自四位與 UoW 和 Google Research 有不同關聯的研究人員。

方法

PersonNeRF 的起點是 HumanNeRF 項目,主要來自同一個研究小組。 HumanNeRF 能夠將 YouTube 視頻中描繪的人轉換為離散且可探索的神經表徵:

開發羅傑·費德勒“實體”的基本“規範空間”。

PersonNeRF 從 HumanNeRF 中移除了非剛性組件的映射,並在其新穎的正則化公式中僅使用骨骼運動。 該項目借鑒了 2022 RegNeRF 計劃中提出的想法,通過在渲染的深度圖上創建“深度平滑度損失”來鼓勵幾何平滑。 作者指出,這種方法鼓勵從透明幾何體(即 NeRF 中描繪的對象之間的空間)創建“霧霾”偽影,這必須通過特殊的不透明度損失算法來修復。

費德勒和論文的其他測試中使用的照片集被細分為外觀集,表示大約在同一時期拍攝的照片。

來自論文,項目中使用的各種照片的示例。

訓練中心不是在單獨的網絡中優化每個所需的方面(外觀一致性和姿態一致性),而是集中在單個多層感知器(MLP)上以獲得規範外觀,所有標記材料都傳遞到其中,對整個集合進行訓練 身體在一個單一的工作流程中傳遞。

規範的 MLP 受到 2021 NeRF in the Wild 項目架構的“啟發”,每個外觀集都綁定到唯一的外觀嵌入向量。 該向量與一個新的姿勢嵌入向量連接,該向量為每個外觀集調節系統的姿勢校正模塊。

培訓與發展

對於 Federer 數據集的核心工作,研究人員通過搜索 2009 年至 2020 年有限年份的特定相關體育賽事來收集照片。每年每個賽事都會產生 19-24 張照片,並且每組照片都被相應地標記。

數據集上的身體姿勢和相機姿勢由 SPIN 估計,儘管研究人員必須在遮擋情況下手動干預,例如費德勒身體的一部分被球拍或其他非固有物品阻擋。 如果不刪除這些項目,它們將基本上融入“費德勒實體”。

該系統使用 Adam 優化器進行訓練,以不同的學習率對規範 MLP 和網絡的其餘部分進行訓練。 該論文指出,優化每個遊戲需要 200,000 次迭代,或者所有遊戲需要 600,000 次迭代,訓練到一個網絡中。

在單個網絡上進行泛化的優點:姿勢一致性得到改善,網絡能夠解析具有未見外觀的姿勢,因為它可以在整個輸入數據范圍內利用更多的相關嵌入。這是基於 NeRF 的項目不常見的泛化級別。

這些結果的作者指出,HumanNeRF 在區域被輸入視圖遮擋的區域產生錯誤,而 PersonNeRF 更強大的泛化能力能夠適應數據差距。

結論

PersonNeRF 是我見過的第一個神經輻射場系統,它能夠以與 GAN 或潛在擴散表示相同的方式概括一個主題。與大多數類似的 GAN 或 LDM 系統不同,網絡中的主題不會與大量相關和不相關的數據一起訓練,因此可探索性僅限於已選擇進行訓練的數據。

儘管如此,很容易想到,後來採用這種方法的 NeRF 架構可能會增加數據量和標籤範圍,從而形成可以通過簡單地訪問受訓系統的參數來實現“編輯”(NeRF 的主要缺點)的系統。

英國AI/VR初創公司Metaphysic 簡介

據VentureBeat報導,英國AI/VR初創公司Metaphysic完成了由Section 32、8VC、TO Ventures、Winklevoss Capital和Logan Paul投資的750萬美元融資。

這家總部位於倫敦的公司致力於研究AI/VR技術,該技術是構建元宇宙的基礎,基於該技術,開發商將能打造《雪崩》、《玩家一號》小說所描繪的虛擬世界。這筆資金將有助於Metaphysic深化開發合成內容創建工具,這些工具將適用於構建元宇宙。

除了開發元宇宙技術,Metaphysic還以新穎的合成媒體內容吸引用戶,這些方式是超現實的、合乎道德的,並且具有獨特的吸引力。

Metaphysic首席執行官Thomas Graham表示,公司的使命是構建元宇宙核心基礎設施,進而實現逼真的虛擬現實體驗和不受時間、空間限制的內容,而完成新融資是達成這一願景的關鍵一步。

Graham還表示:“我們很高興得到了出色的投資者的支持,他們在擴展新技術和創建流行內容方面有著豐富的經驗,我們將共同打造人工智能和數據管理工具,使創作者將他們對現實的感知導入虛擬世界,有遠見的投資者和內容創作者都明白,人類感官及內容體驗的未來在於數字領域,而Metaphysic憑藉突破性技術將數字體驗提升到了相當高的程度,從而無縫鏈接虛擬世界和現實世界。”

去年春天,Metaphysic推出了湯姆·克魯斯合成視頻,引發大量網民關注,除此之外Metaphysic還發布了包括戴夫·馬修斯樂隊熱門歌曲《Crash》在內的合成內容。

留言

張貼留言